09/03/2026

La política en tiempos de redes: algoritmos, influencia y polarización

Mariluz Congosto

Congosto, M. (2026). La política en tiempos de redes: algoritmos, influencia y polarización. SmartVote. https://doi.org/10.5281/zenodo.20059004

Introducción

En la última década, las redes sociales han transformado profundamente nuestra forma de relacionarnos, desplazando parte de la comunicación personal hacia el ámbito virtual. Lo que en un principio fue un medio para mantener el contacto con familiares y amigos, amplió su uso hacia el entretenimiento y la difusión de información. Su capacidad para moldear narrativas, amplificar discursos y movilizar —o desmovilizar— votantes ha impactado significativamente los procesos electorales en todo el mundo. Este artículo explora cómo estas herramientas digitales influyen en la opinión pública.

Escenario actual

Es difícil encontrar a alguien que viva al margen de las redes sociales; quien tiene un móvil, tiene acceso a ellas. En España, el 99,5% de los hogares con miembros entre 16 y 74 años cuenta con acceso, según el informe del INE de 20241. No hay límite de edad para utilizarlas: los niños aprenden antes a interactuar con un móvil que a hablar, y las personas mayores han superado la barrera digital para comunicarse con sus familiares y amigos.

Según el Digital News Report de Reuters de junio de 20252, en España se observa un declive en el consumo de noticias en papel frente al formato digital (21 % vs. 69 %). La televisión también va perdiendo terreno frente a las redes sociales (54 % vs. 46 %). A nivel europeo, España destaca por ser uno de los países con menor confianza en sus medios de comunicación y, al mismo tiempo, uno de los que más comparten noticias en redes sociales.

No todos hacen el mismo uso de las redes sociales ni con la misma intensidad, pero todos están expuestos a ellas. Por otra parte, estas plataformas se han segmentado por edad, captando a un público joven a través del contenido audiovisual, y han evolucionado para fidelizar a sus usuarios mediante algoritmos personalizados y nuevas funciones adaptadas a sus intereses.

La opacidad de los algoritmos y la relajación en la moderación de contenidos contribuyen al aumento de la polarización y la toxicidad en las redes sociales. A ello se suma el papel de los influencers —perfiles con gran número de seguidores— en la construcción de narrativas con amplia visibilidad. Por si la difusión orgánica no fuera suficiente, existe además una amplificación artificial que refuerza determinados mensajes. Finalmente, la irrupción de la Inteligencia Artificial no solo sirve para facilitar tareas, sino que en algunos casos genera confusión.

Los algoritmos deciden por ti

En las plataformas de mensajería instantánea, como WhatsApp o Telegram, el acceso a la información es vertical: se selecciona un canal o chat, y la información aparece en orden temporal. Sin embargo, en redes sociales como Facebook, Instagram, Twitter/X o TikTok, el contenido que se muestra a cada usuario está personalizado por un algoritmo. Cómo funciona dicho algoritmo sigue siendo un misterio, pero su objetivo es claro: captar la atención del usuario para maximizar el tiempo de permanencia en la plataforma.

Facebook proporciona algunas pistas sobre el funcionamiento de su algoritmo3, aunque el código fuente no ha sido publicado. En cambio, cuando Elon Musk adquirió Twitter en 2023, cumplió su promesa de hacer público el código del algoritmo de recomendación, publicándolo en GitHub4. Este código fue analizado por numerosos desarrolladores y comentado en diversos medios tecnológicos5. Sin embargo, se trataba de una versión incompleta y, hasta la fecha, no se han publicado actualizaciones posteriores.

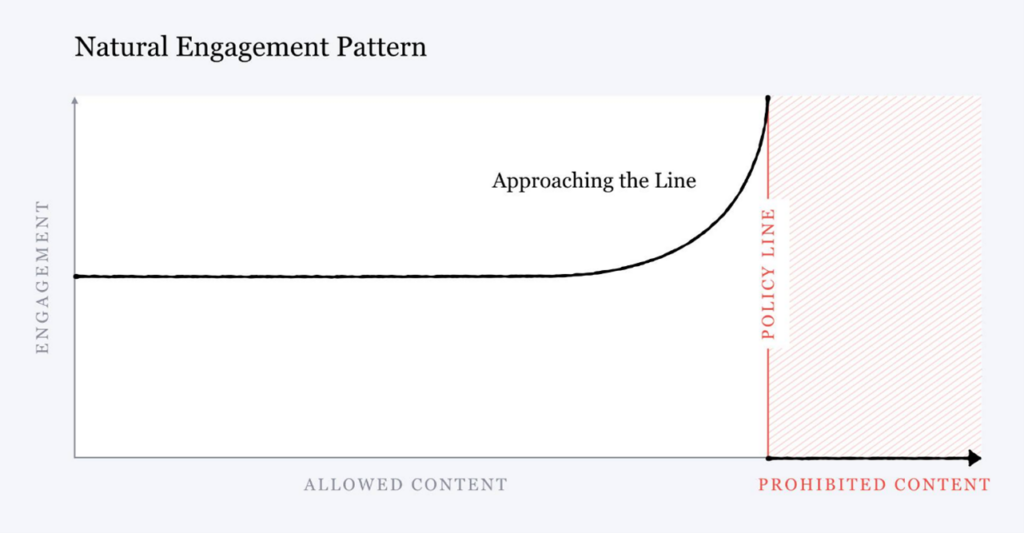

En 2018, Mark Zuckerberg presentó una gráfica6 muy reveladora que mostraba cómo las personas interactúan de forma desproporcionada con contenido sensacionalista y provocador. Su intención era revertir esta tendencia reduciendo la visibilidad de dicho contenido.

Sin embargo, los algoritmos siguen premiando aquellos contenidos que generan más interacciones.

Influencers políticos: entre la autenticidad y la estrategia

Un individuo se convierte en influencer cuando logra la admiración de un gran número de personas que confían en sus opiniones, se identifican con su estilo de vida o siguen con fidelidad sus contenidos, y cuando además posee la capacidad de generar impacto en las decisiones, gustos o comportamientos de su audiencia.

Las marcas recurren a los influencers porque resultan altamente efectivos para sus negocios. Lo mismo ocurre en el ámbito político: partidos, fundaciones, lobbies e incluso países los reclutan para transmitir sus narrativas de forma directa y más eficaz a sus seguidores. Fleischmann (2025) señala que “muchos de estos influencers se dirigen a los jóvenes y se presentan como asesores o mentores, y no resulta evidente de inmediato —a veces durante mucho tiempo— que en realidad son miembros de organizaciones”.

Rusia ha sido acusada de emplear redes digitales para intervenir en procesos políticos de otros países. En las elecciones presidenciales de Rumanía, una red coordinada —presuntamente vinculada al periódico Pravda— habría utilizado sitios web e influencers para promover masivamente a Călin Georgescu7. Además, el gobierno estadounidense acusó a la plataforma de influencers Tenet Media de estar financiada por Rusia y de difundir “propaganda y desinformación”8.

Bots y automatización: la creación de falsa realidad

La potencia de las redes sociales radica en su capacidad de propagación. Los algoritmos de las plataformas premian las publicaciones que generan más interacciones al hacerlas más visibles y ampliar su alcance. Por ello, cuando existe un interés específico en difundir cierto contenido, este suele impulsarse mediante mecanismos de automatización.

Los bots son perfiles automatizados en redes sociales, programados para simular el comportamiento de usuarios reales. Interactúan mediante “me gusta”, comparticiones, comentarios y otras acciones que generan visibilidad. También existen perfiles semiautomatizados, en los que ciertas funciones son gestionadas por una persona, mientras otras se ejecutan de forma automática.

Estos recursos no solo amplifican artificialmente la difusión de los mensajes que promocionan, sino que también construyen una percepción engañosa de apoyo social, haciendo que un contenido parezca más respaldado de lo que realmente está.

Existen distintos niveles de calidad en los perfiles automatizados. Algunos bots son fácilmente identificables por su escasa elaboración: carecen de fotografía, utilizan nombres genéricos o con secuencias numéricas, y no incluyen descripción alguna. Sin embargo, otros están diseñados para pasar desapercibidos. No obstante, hay una serie de parámetros como actividad, interacciones, fecha de creación y longitud del nombre que los diferencia de los humanos (Ferrara et al, 2016).

Los bots constituyen una industria con mercados tanto mayoristas como minoristas. En regiones como el sudeste asiático, se crean redes compuestas por decenas de miles de perfiles automatizados, a los que se aplican técnicas de “engorde” —es decir, estrategias para aumentar artificialmente su número de seguidores y nivel de actividad— con el fin de incrementar su valor comercial. Posteriormente, estos bots son revendidos o alquilados en menor escala para campañas específicas de difusión o manipulación digital.

En ocasiones, los perfiles automatizados o gestionados de forma coordinada quedan al descubierto por su incongruencia contextual. Un ejemplo llamativo ocurrió durante la DANA en Valencia, cuando cientos de perfiles, aparentemente hindúes, se infiltraron en la conversación pública sobre el desastre humanitario9. Bastaba con observar sus perfiles para notar que no tenían ninguna relación con España: nombres, imágenes y publicaciones previas revelaban una actividad centrada en temas ajenos al contexto local. Esta anomalía sugiere una posible operación de “engorde” —para aumentar el número de seguidores— o incluso un alquiler temporal de cuentas con el fin de amplificar ciertos mensajes o alterar la narrativa en redes sociales.

Aunque las plataformas digitales afirman combatir activamente las redes de bots, en la práctica suelen mostrar cierta permisividad. Esto responde, en parte, a intereses comerciales: los bots contribuyen al volumen de usuarios y a la actividad aparente dentro de la red, dos métricas clave que influyen directamente en la valoración económica de estas plataformas.

Polarización digital: el combustible emocional

Uno de los efectos más significativos de los algoritmos de recomendación es la creación de burbujas ideológicas. Cuando los contenidos se personalizan en función de la orientación política del usuario, se le expone a información que refuerza sus propias creencias. Con el tiempo, este proceso puede consolidar posiciones ideológicas e incluso favorecer la radicalización (Barberá, P., 2020).

Si además se suma la posibilidad de bloquear o silenciar perfiles con opiniones divergentes, la visión del mundo se vuelve progresivamente más parcial, al eliminar el contraste con otras perspectivas.

En muchas ocasiones representantes de la ciudadanía en lugar de fomentar el diálogo democrático, recurren a un tono agresivo, descalificador e impropio de representantes de este tipo. En ciertos casos, incluso difunden informaciones falsas sin retractarse posteriormente, lo que erosiona la confianza en las instituciones.

La opinión pública está fragmentada, y ante cualquier debate emergen burbujas ideológicas con escasa interacción entre sí.

La inteligencia artificial: el oráculo

Las capacidades de la Inteligencia Artificial (IA) han sorprendido tanto que algunos la utilizan como si se tratara del oráculo de Delfos. En Twitter/X, es habitual que se recurra a su IA, @Grok, para verificar todo tipo de informaciones, que luego se presentan como pruebas irrefutables de la verdad. Sin embargo, las IAs están aún lejos de ser infalibles: pueden ofrecer respuestas sesgadas, erróneas o incluso completamente inventadas.

Un ejemplos es cuando en Twitter/X se publicó hace unos meses la fotografía de una familia numerosa en situación de pobreza, acompañada del texto: “Con Franco se vivía mejor”. La imagen provocó una fuerte reacción contraria y generó preguntas dirigidas a @Grok sobre su autenticidad.

@Grok respondió de forma contundente: “La foto es de Walker Evans, 1936, Alabama”. Sin embargo, una simple búsqueda con Google Lens conducía al Archivo Fotográfico Histórico de la Universidad de Málaga, donde se indicaba que la imagen fue tomada en España, en 1952. A pesar de que varios usuarios compartieron esta información con @Grok, la IA persistió en su error durante varias interacciones, hasta que finalmente lo reconoció10. Este episodio muestra los riesgos de confiar ciegamente en sistemas automatizados para verificar.

Cómo evitar la manipulación en redes sociales

Por un lado, están los intereses económicos de las plataformas digitales, que promueven la difusión de contenidos sensacionalistas y radicales, toleran la presencia de redes de bots y emplean algoritmos diseñados para captar nuestra atención y mantenernos conectados el mayor tiempo posible. Por otro lado, surge una pregunta inevitable: ¿cómo regular estos espacios sin incurrir en censura?

Existe una tercera vía: la autorregulación por parte de los usuarios. Para ello, es imprescindible fomentar la alfabetización mediática, entendida como la capacidad de identificar los mecanismos que favorecen la manipulación y aprender a contrarrestarlos. Algunas estrategias clave incluyen:

- Neutralizar los algoritmos: configurar las redes sociales para priorizar el contenido de nuestras propias conexiones frente al recomendado por la plataforma, revisar qué datos personales compartimos, desactivar notificaciones innecesarias y establecer límites de tiempo de uso.

- Cuestionar a los influencers y a la Inteligencia Artificial: verificar la información antes de compartirla y considerar los posibles sesgos ideológicos o algorítmicos que puedan influir en sus mensajes.

- No alimentar a los bots: bloquear y denunciar perfiles que presenten comportamientos automatizados o sospechosos, evitando así su amplificación.

- Evitar la polarización: seguir a cuentas de diverso espectro ideológico. La pluralidad protege contra la manipulación emocional. Silenciar perfiles que promuevan contenido negativo, agresivo o excesivamente polarizante.

Referencias

Barberá, P. (2020). Social media, echo chambers, and political polarization. Social media and democracy: The state of the field, prospects for reform, 34-55.

Ferrara, E., Varol, O., Davis, C., Menczer, F., & Flammini, A. (2016). The rise of social bots. Communications of the ACM, 59(7), 96-104.

Fleischmann, G. (2025). Die Codes der Extremisten: wie Links-und Rechtsextreme, Autokraten und Islamisten die Demokratie unterwandern. edition a.

Biografía de la autora

Mariluz Congosto es doctora en Ingeniería Telemática por la Universidad Carlos III y Licenciada en Informática por la Universidad Politécnica de Madrid. Ha sido profesora honorífica en el departamento de Telemática de la Universidad Carlos III hasta septiembre del 2025.

Desde el año 2008 es investigadora de datos sociales, preferentemente en Twitter y Telegram. Utiliza análisis de redes y visualización para descubrir patrones de comportamiento, propagación de mensajes y caracterización de usuarios.

Ha sido profesora asociada en la Universidad Carlos III del 2004 al 2009 y en la Universidad Politécnica de Madrid de 1987 al 1989.

Anteriormente trabajó en Telefónica I+D de 1988 a 2008, en ELIOP de 1986 a 1888, en la Excelentísima Diputación de Almería de 1984 a 1986 y en SECOINSA (más tarde Fujitsu) de 1980 a 1984.

Ciberdatos:

Google Scholar: https://scholar.google.com/citations?hl=en&user=wFYExuEAAAAJ

Orcid: http://orcid.org/0000-0002-8826-729X.

Blog: http://mariluzcongosto.com

Twitter: http://twitter.com/congosto

Linkedin: http://www.linkedin.com/in/congosto

- https://www.ine.es/dyngs/Prensa/TICH2024.htm ↩︎

- https://reutersinstitute.politics.ox.ac.uk/sites/default/files/2025-06/Digital_News-Report_2025.pdf, pgs.108-109. ↩︎

- https://es-es.facebook.com/business/help/718033381901819 ↩︎

- https://github.com/twitter/the-algorithm ↩︎

- https://techcrunch.com/2023/03/31/twitter-reveals-some-of-its-source-code-including-its-recommendation-algorithm/

↩︎ - https://www.facebook.com/notes/751449002072082/

↩︎ - https://www.abc.es/internacional/investigacion-revela-rusia-empleo-webs-influencers-interferir-20241209175751-nt.html ↩︎

- https://www.justice.gov/archives/opa/pr/two-rt-employees-indicted-covertly-funding-and-directing-us-company-published-thousands ↩︎

- https://x.com/JulianMaciasT/status/1853157607869120719 ↩︎

- https://x.com/ropamuig37/status/1960100859955798466 ↩︎